通过全局安装 sync-socials-agent 技能,让兼容 MCP 的 AI 代理自动同步社交媒体内容。

为 MCP 框架全局安装社交媒体同步代理技能。

📅 2026/04/18

Deploy & Ops

浏览 开发 分类的 OpenClaw 玩法

为 MCP 框架全局安装社交媒体同步代理技能。

📅 2026/04/18

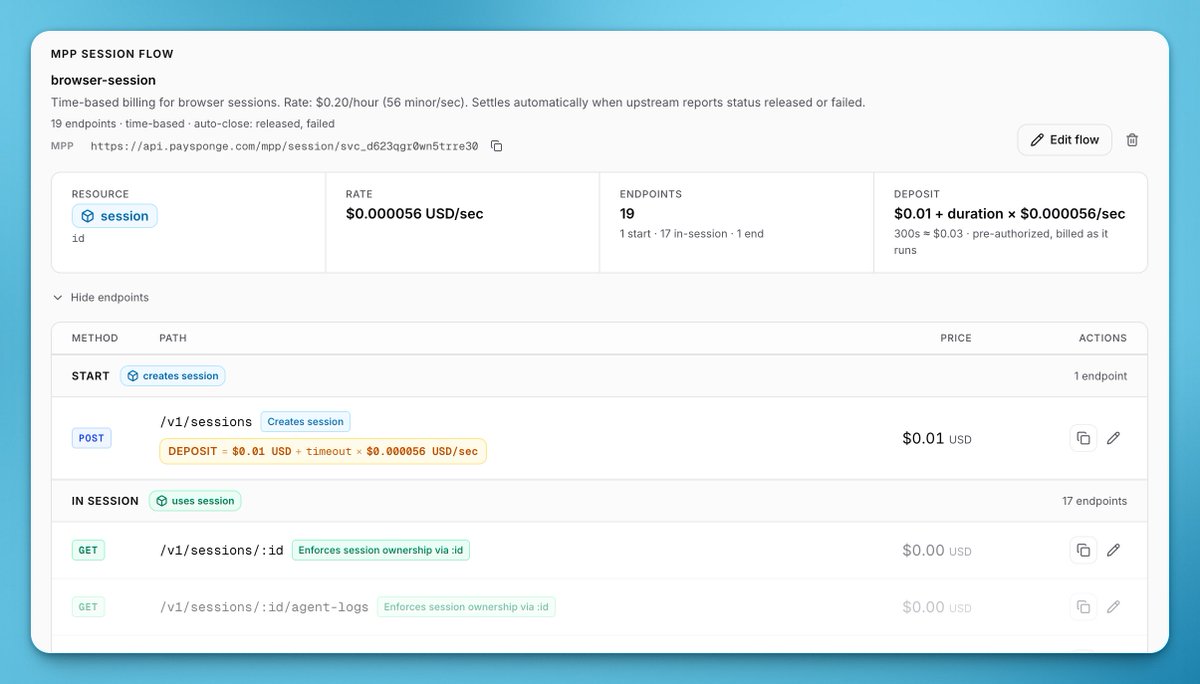

利用 Sponge Gateway 和 MCP 协议为 AI 智能体配置动态计价模型(按请求、按用量、按时长)。

📅 2026/04/18

介绍 OpenClaw 4.15 的新特性,包括实现配置可移植的云记忆、支持 Opus 4.7、独立梦境文件夹、本地模型精简模式优化以及自动工具循环检测,旨在稳定代理工作流。

📅 2026/04/17

采用 Hermes Agent 进行本地 LLM 编码,利用其稳健的工具调用和无配置服务器集成优势。

📅 2026/04/17

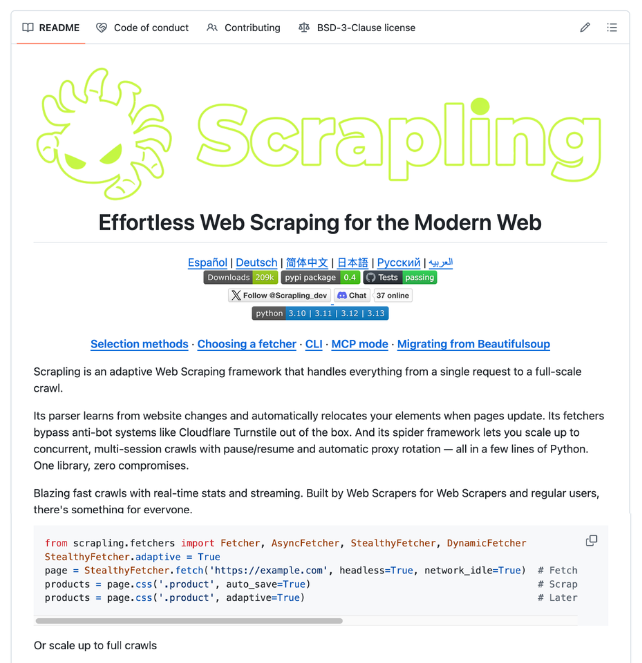

自动化自适应网页抓取,可绕过 Cloudflare 并在站点布局变化时自我修复。

📅 2026/04/17

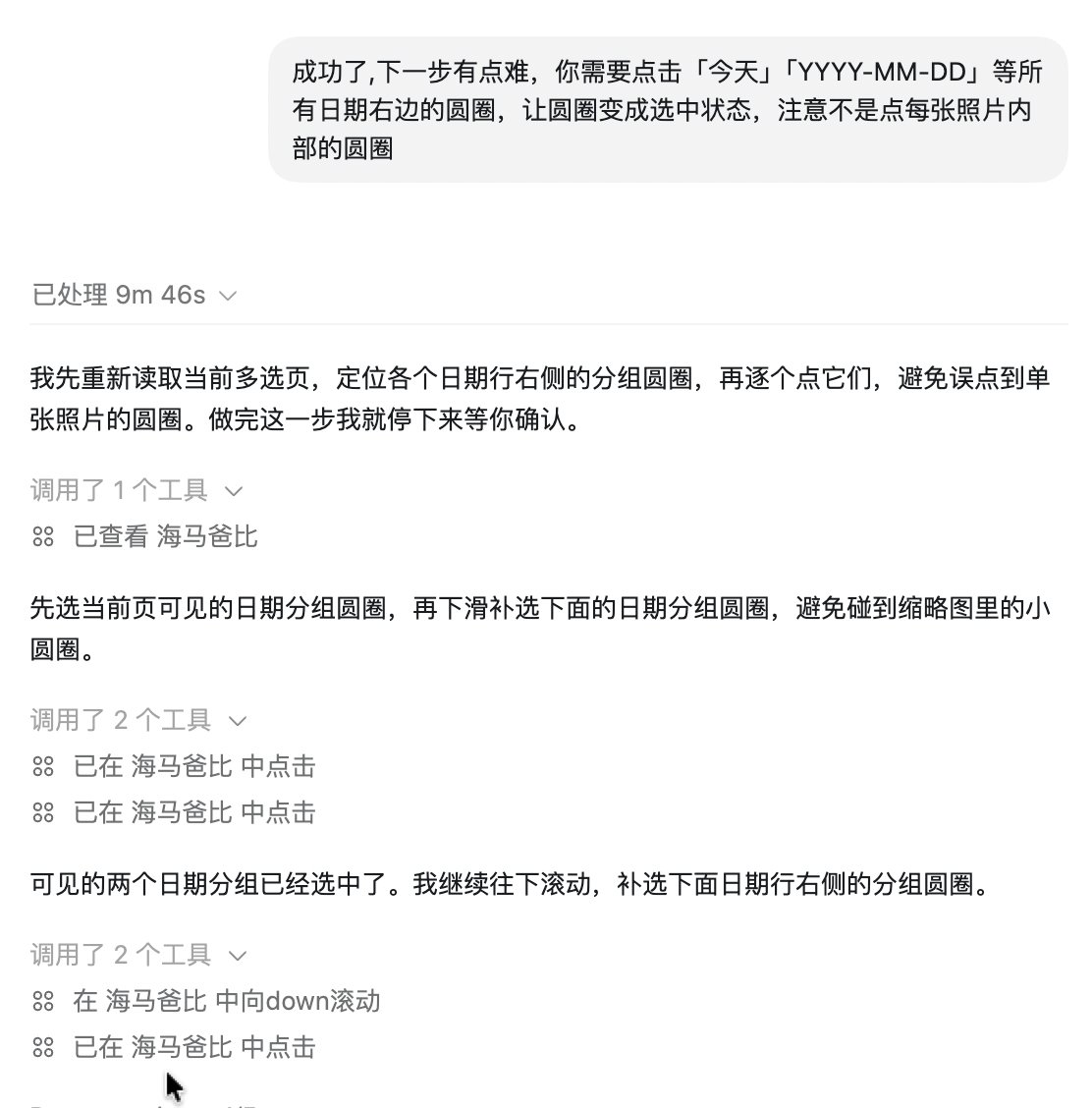

横向评测 Codex Computer Use 的后台自动化能力并对比 OpenClaw 和 Midscene 的性能表现。

📅 2026/04/17

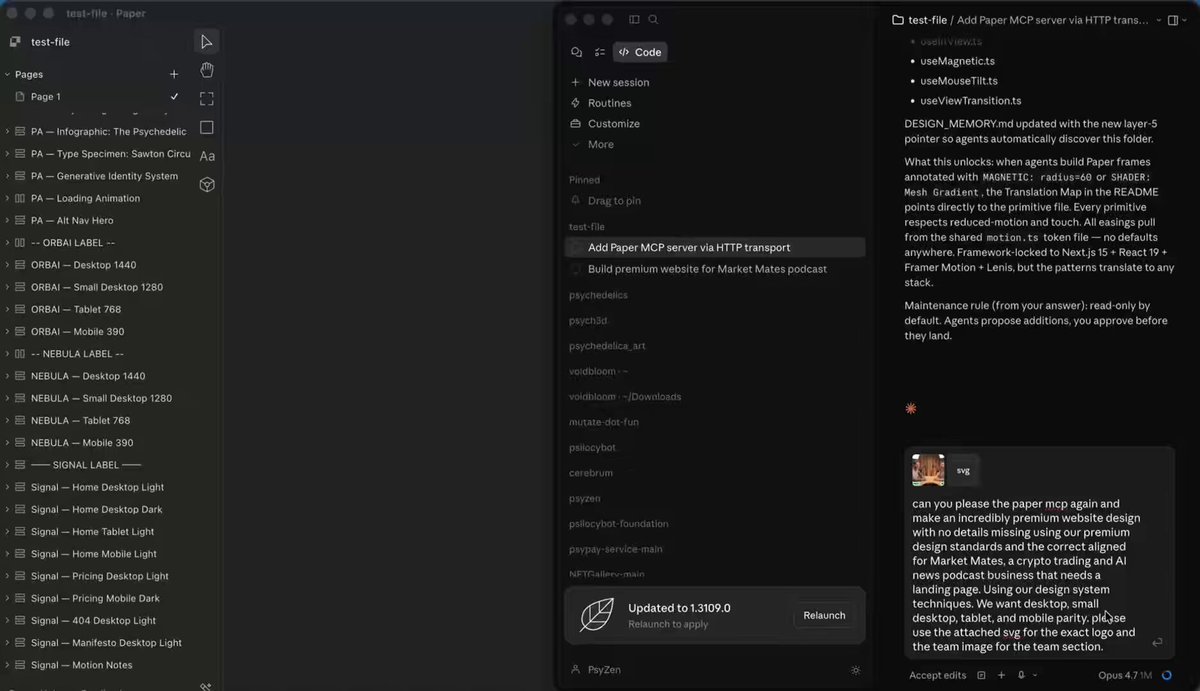

通过编排 Claude Code、Paper Design MCP 和自定义代理,实现从提取设计风格、生成视觉图到编写代码的全自动网站建设流程。

📅 2026/04/17

显示第 13 - 24 至 726 项